Tudjuk, hogy Apple sokat törődik az ökoszisztéma eszközein áthaladó adatok titkosságával és azzal, hogy nagyon jól védettek a kíváncsiskodó szemektől. Ez azonban nem jelenti azt, hogy a felhasználók ne tartsák be az etikával, az erkölccsel, és miért ne az emberséggel kapcsolatos szabályokat.

Apple bejelentette, hogy hamarosan piacra dob egy olyan technológiát, amely képes a felhasználók által tárolt összes kép beolvasására iCloud és azonosítani kell azokat a fényképeket, amelyek gyermekek elleni szexuális bántalmazást tartalmaznak. Gyermekekkel való szexuális bántalmazás (CSAM).

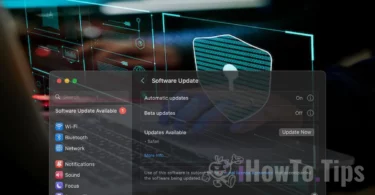

Ezt a technológiát a Apple az év vége felé, valószínűleg kísérleti verzióban, kis számú felhasználó számára.

Ha kíváncsi, hogy "hol van az adatok bizalmassága?", Tudja meg, hogy minden, amit kapunk, tartalom videó / fotó titkosított protokollon keresztül történik. Valamint az adatok tárolásához iCloud titkosítva van, de az ilyen szolgáltatások szolgáltatói rendelkeznek a kulccsal az adatok titkosításához. Itt nem csak arról beszélünk Apple. Microsoft, Google és egyéb adattárolási szolgáltatások cloud Ugyanezt csinálom.

A tárolt adatok visszafejthetők és ellenőrizhetők, ha jogi lépésben kéri őket, vagy ha nyilvánvalóan megsértik a törvényeket. Ilyenek például a gyermekek és nők elleni erőszakos cselekmények.

A felhasználók bizalmas kezelése érdekében a vállalat a NeuralHash nevű új technológiára támaszkodik, amely a beolvasott fényképeket szkenneli iCloud és azonosítja azokat, amelyek gyermekekkel szembeni erőszakot tartalmaznak, összehasonlítva őket az adatbázis más képeivel.

Ez némileg hasonlít az arcfelismeréshez vagy a tárgyak, állatok és egyéb elemek intelligens felismeréséhez.

A technológia képes lesz beolvasni és ellenőrizni az iPhone, iPad vagy Mac eszközön készült vagy átvitt képeket, még akkor is, ha változásokon mennek keresztül.